Perang dan Kecerdasan Artifisial

Penggunaan kecerdasan artifisial dalam perang mengancam kemanusiaan. Namun, belum ada aturan dan etika pemanfaatannya.

Mobil dan bangunan terlihat terbakar setelah serangan rudal di Kyiv, Ukraina, pada 2 Januari 2024, di tengah invasi Rusia ke Ukraina.

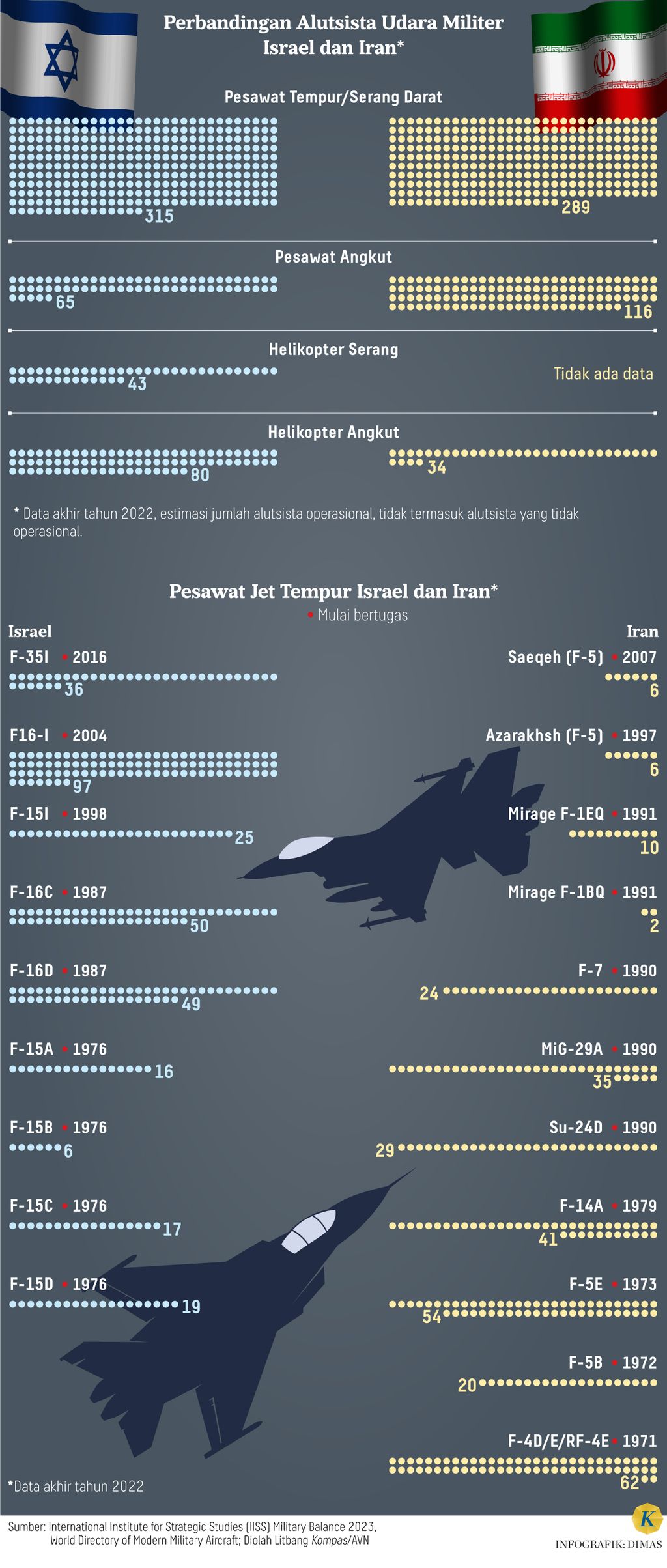

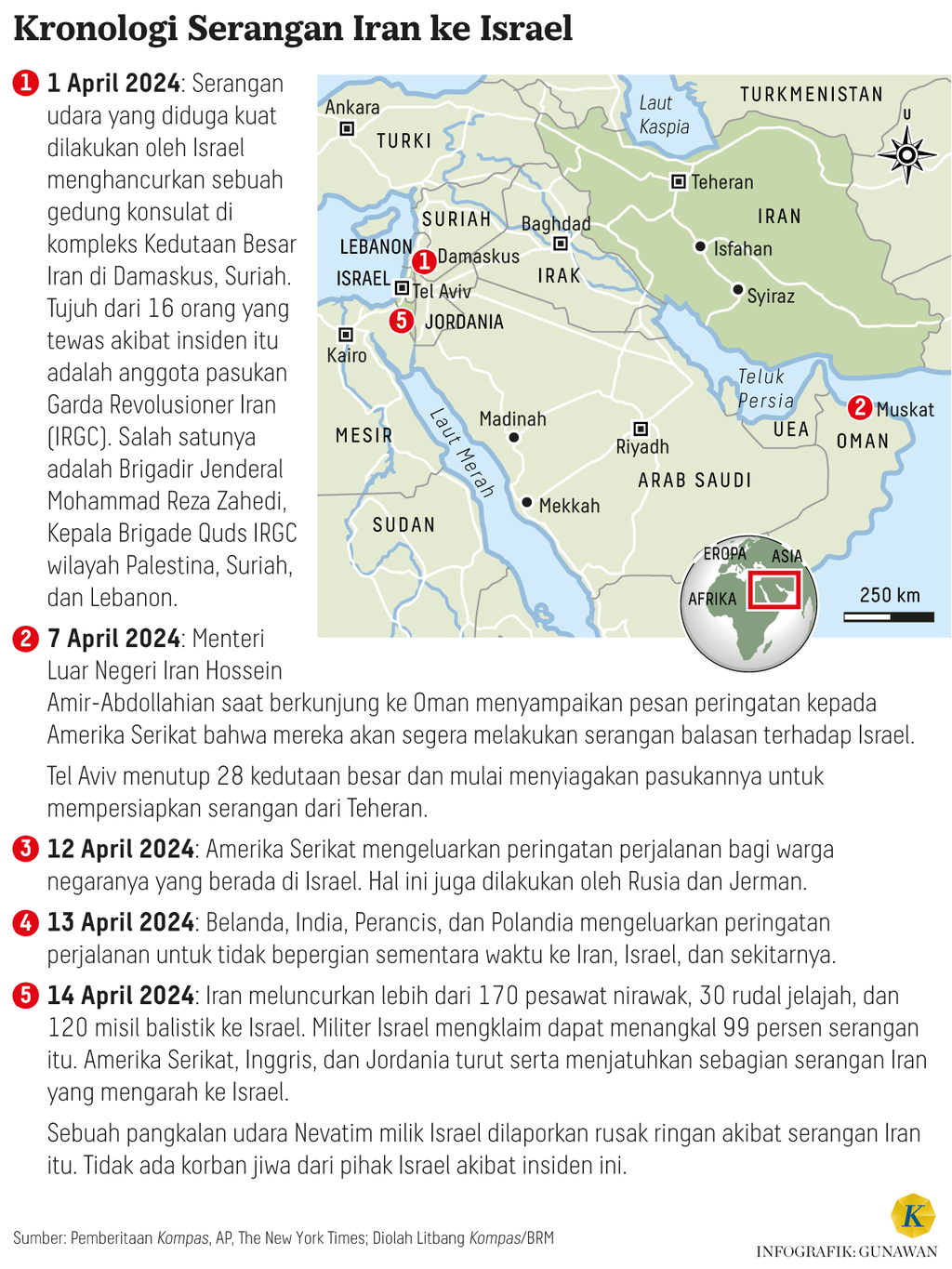

Dalam perang antara Rusia-Ukraina, Israel-Hamas, ataupun Isarel-Iran, penggunaan senjata otonom yang dilengkapi kecerdasan artifisial meningkat dan berkembang pesat. Namun, pemanfaatan kecerdasan buatan untuk senjata itu menimbulkan keprihatinan atas kemanusiaan.

Pesawat udara nirawak (PUNA) alias drone menjadi ujung tombak serangan untuk menaklukkan lawan. Korbannya bukan hanya tentara dan infrastruktur militer, melainkan juga banyak rakyat sipil dan fasilitas publik turut menjadi sasaran. Manusia hanya dianggap sebagai obyek sasaran tempur, bukan individu dengan segala kemanusiaannya.

Beberapa peperangan dalam beberapa tahun terakhir menunjukkan makin masifnya penggunaan kecerdasan artifisial (AI) dalam sistem senjata otonom oleh negara-negara yang bertikai. Namun, hingga kini belum ada konsensus bersama antarnegara dalam meregulasi ataupun penyusunan etika dalam pemanfaatan AI untuk kepentingan perang.

Kecerdasan buatan merupakan bagian dari ilmu komputer yang fokus dalam memecahkan masalah-masalah terkait dengan kognisi atau proses manusia memperoleh pengetahuan. Sistem ini berbasis pada algoritma yang meniru kecerdasan manusia, mulai dari pengenalan, pembelajaran, hingga penciptaan sesuatu.

Baca juga: Dilema Perang dan Kemanusiaan pada Kecerdasan Buatan

Sistem kecerdasan buatan bertumpu pada algoritma yang dibangun. Dalam algoritma sederhana, komputer atau mesin hanya akan merespons sesuai pertanyaan atau masalah yang diajukan manusia. Namun, dalam algoritma AI, umumnya didasarkan atas sistem mesin pemelajar (machine learning/ML) yang mampu membuat instruksi sendiri berdasarkan data dan pengalaman yang dimiliki.

Seorang pakar memeriksa lubang setelah serangan Rusia ke pusat kota Kharkiv, di Rusia, pada 6 Oktober 2023, di tengah invasi Rusia ke Ukraina. Dalam serangan itu, setidaknya 16 orang terluka dan seorang anak dilaporkan tewas.

Kemajuan atau kepintaran mesin pemelajar ini sangat ditentukan oleh kemampuan mesin untuk terus ”belajar” berdasarkan data yang dimiliki. Sifat ini membuat meski masukan yang diberikan ke mesin sama, keluaran atau hasilnya tidak selalu sama sehingga sulit diprediksi. Keluaran inilah yang membedakan antara algoritma sederhana dengan algoritma mesin pemelajar.

Karakteristik mesin pemelajar itu mampu memberikan solusi tanpa ada perintah atau campur tangan manusia. Karena itu, mesin pemelajar seringkali dianggap sebagai ”kotak hitam”. Meski data masukan ke mesin pemelajar bisa diketahui, sulit untuk menjelaskan secara retrospektif keluaran yang dihasilkan mesin tersebut.

Pemanfaatan kecerdasan buatan untuk senjata itu menimbulkan keprihatinan atas kemanusiaan.

Komite Palang Merah Internasional (ICRC) pada 6 Oktober 2023 mencermati, pemanfaatan kecerdasan artifisial untuk kepentingan militer itu setidaknya sudah digunakan dalam tiga bidang, yaitu meningkatkan mutu senjata otonom, alat penopang perang informasi dan operasi siber, serta untuk pengambilan keputusan secara cepat di lingkungan militer.

Senjata otonom

Penerapan AI dalam senjata otonom mendapat perhatian utama dari berbagai kalangan karena memiliki dampak serius bagi manusia dan kemanusiaannya. Kecerdasan artifisial bisa digunakan untuk menyerang seseorang, kendaraan, atau fasilitas lain secara langsung tanpa campur tangan manusia.

Menurut penasihat saintifik dan kebijakan senior ICRC, Neil Davison, di situs ICRC, 26 Juli 2022, manusia memang bisa mengaktifkan senjata otonom, tetapi manusia tidak mengetahui secara spesifik siapa atau apa yang akan diserang oleh senjata tersebut. Manusia juga tidak mengetahui kapan dan di mana senjata otonom itu akan menyerang.

Senjata otonom bekerja dengan sensor dan perangkat lunak yang berfungsi untuk mencocokkan apa yang dideteksi sensor di lingkungan target. Senjata otonom bisa mendeteksi bentuk kendaraan militer atau pergerakan seseorang. Namun, pergerakan kendaraan atau orang itu memicu terjadinya serangan. Serangan tidak ditentukan oleh pemegang atau pengendali senjata.

Proses penentuan serangan inilah yang menimbulkan keprihatinan karena tidak adanya peran manusia dalam penggunaan kekerasan. Akibatnya, senjata otonom menjadi sulit dikontrol.

Tidak ada jaminan bahwa kendaraan atau orang yang diserang itu benar-benar berasal dari militer, bukan warga sipil. Kalaupun yang diserang benar-benar sasaran militer, tidak ada jaminan warga atau fasilitas sipil di dekatnya terbebas dari dampak serangan tersebut.

Situasi ini, menurut asisten profesor psikologi Universitas Concordia, Kanada, Jordan Richard Schoenherr, di The Conversation, 10 Desember 2023, mengarah ke perang total, yaitu semua melawan semua.

Dalam perang total ini, batasan antara orang dan infrastruktur sipil atau militer menjadi kabur. Artinya, mereka yang berperang akan menganggap semua orang, termasuk perempuan dan anak, semua fasilitas publik, termasuk rumah sakit dan fasilitas kemanusiaan lain, bersifat setara dan menjadi target sasaran yang sah.

Perang informasi

Selain untuk senjata, kecerdasan artifisial juga banyak digunakan dalam pengambilan keputusan militer. Komputer berbasis AI bisa menganalisis, menggabungkan data, hingga memperoleh kesimpulan dalam mengidentifikasi dan menilai perilaku seseorang atau obyek tertentu. AI juga bisa memprediksi tindakan dan situasi di masa depan dengan cepat dan efisien.

Seorang anggota angkatan bersenjata Iran memimpin orkestra tentara saat sebuah truk mengangkut sebuah rudal dalam parade militer sebagai bagian dari upacara memperingati Hari Tentara tahunan di Teheran, Iran, pada 17 April 2024.

Simpulan dari mesin pemelajar itu bisa menjadi rekomendasi untuk melakukan operasi militer, menentukan siapa yang akan diserang dan waktunya, bahkan menyarankan penggunaan senjata nuklir. Kondisi ini membuat banyak kalangan khawatir bahwa militerisasi AI justru memiliki konsekuensi besar terhadap hukum humaniter internasional dan etika perang.

Meski kekhawatiran itu sudah terjadi dalam sejumlah perang yang terjadi beberapa tahun terakhir, sebagian pihak justru menilai sebaliknya. Pengambilan keputusan oleh mesin dianggap menguntungkan karena mesin lebih bisa menjaga kepatuhan terhadap hukum dan etika serta menghindari seoptimal mungkin korban sipil.

Kecerdasan artifisial juga banyak digunakan sebagai alat memenangkan perang informasi untuk mendukung serangan yang dilakukan. AI juga menjadi penopang utama perang siber untuk melumpuhkan kekuatan dan fasilitas lawan.

Kecerdasan buatan dan mesin pemelajar bisa secara otomatis mencari kerentanan sistem musuh untuk dirusak, sekaligus mendeteksi kelemahan sistem sendiri. Saat muncul serangan siber, AI bisa menyerang balik sistem informasi lawan secara otomatis. Upaya ini bisa meminimalkan dampak serangan siber terhadap masyarakat ataupun infrastruktur sipil.

Selain itu, dalam perang, pemenang tidak hanya ditentukan oleh seberapa banyak jumlah musuh yang bisa ditaklukkan. Pemenang perang adalah kelompok yang mampu mengendalikan informasi yang beredar di masyarakat luas.

Seorang anggota militer Israel berjalan di dekat rudal balistik Iran yang jatuh di Israel di pangkalan militer Julis dekat kota Kiryat Malachi, Israel, Selasa (16/4/2024). Iran meluncurkan ratusan rudal balistik dan drone ke Israel pada Minggu. Militer Israel menyatakan hampir semua rudal dapat dicegat.

Kesuksesan perang informasi ini bisa mengaburkan informasi perang yang sebenarnya, bahkan mendapat dukungan masyarakat dari negara-negara yang tidak terlibat dalam peperangan langsung.

Sejak lama, perang informasi memang telah menjadi bagian tak terpisahkan dari konflik bersenjata. Medan perang digital dan kecerdasan buatan telah mengubah bagaimana cara informasi dan disinformasi diciptakan dan disebarkan.

Sistem yang didukung AI telah banyak menghasilkan konten palsu, baik berupa teks, foto, audio, dan video. AI juga mampu mengubah sifat dan skala manipulasi informasi dan dampaknya di dunia nyata.

Tata kelola

Meski militerisasi kecerdasan artifisial memiliki dampak besar bagi kemanusiaan, keamanan, dan perang global, mekanisme tata kelola penggunaannya serta mitigasi dari potensi bahaya yang ditimbulkannya justru belum tersedia.

Rektor Universitas Perserikatan Bangsa-Bangsa (UNU) Tshilidzi Marwala di situs UNU, 24 Juli 2023, menulis sulitnya pengaturan pemanfaatan kecerdasan artifisial untuk kepentingan militer. Hal ini disebabkan tingginya kompleksitas teknis kecerdasan artifisial dan pesatnya perkembangan kecerdasan buatan. Akibatnya, aturan yang sudah ada akan sulit dipatuhi.

Baca juga: Teknologi Robotik dan Kecerdasan Buatan Jadi Kunci AS Ungguli Militer China

Tata kelola kecerdasan artifisial yang sudah ada umumnya disusun berdasarkan peristiwa di masa lalu, bukan sesuatu yang bakal terjadi di masa depan. Pesatnya perkembangan kecerdasan buatan membuat aturan yang ada seharusnya bersifat dinamis dan mampu beradaptasi dengan situasi yang berkembang di masa depan.

Di sisi lain, kerja sama internasional untuk menyusun regulasi penggunaan kecerdasan artifisial juga sulit dibangun karena belum adanya konsensus antarnegara, khususnya negara-negara yang maju dalam industri militer dan pengembang AI. Tak hanya itu, sifat ganda dari kecerdasan buatan yaitu bisa dimanfaatkan untuk kepentingan sipil ataupun militer, mempersulit penyusunan regulasi AI.

Pengaturan etika kecerdasan artifisial juga tak kalah pelik. Banyak persoalan terkait pemanfaatan kecerdasan buatan yang belum bisa dijawab, seperti bagaimana cara senjata otonom membedakan antara prajurit dan warga sipil atau siapa yang bertanggung jawab jika senjata yang ditenagai AI menyebabkan kerusakan yang tidak disengaja terhadap fasilitas sipil atau membunuh warga sipil.

Selain itu, pertanyaan mendasar yang belum bisa dijawab adalah apakah etis mendelegasikan keputusan terhadap hidup dan mati seseorang, meski itu adalah musuh atau pihak yang dianggap jahat, kepada mesin? Mesin yang semula dibuat untuk memudahkan manusia pada akhirnya akan menjadi sarana yang membunuh manusia.

Baca juga: Serangan Iran ke Israel, Puncak Perseteruan Negara Adidaya Timur Tengah

Kita memang sudah tidak bisa mundur lagi dari penggunaan AI. Pada akhirnya, pemakaian kecerdasan artifisial akan menjadi sebuah keniscayaan. Namun, sejauh apa manusia bisa mengendalikan hasratnya agar teknologi yang diciptakannya tidak justru menurunkan derajat kemanusiaannya?